WGAN - ChaeyeonSon/PaperReading GitHub Wiki

Wasserstein GAN

https://arxiv.org/pdf/1701.07875.pdf

1. Introduction

- problem: unsupervised learning

- P_r density를 예측하기보단 random 변수 Z를 고정 분포 p(z)로 정의하고 generator로 보내면 특정 분포를 만들어내는데 파라미터를 다양하게 해서 실제 데이터 분포에 가까워지게 할 수 있다.

- 장점 1. low dimensional manifold 로 분포 제한가능 2. 쉽게 샘플을 만들어내는 능력이 density아는 것보다 유용.

- VAE(approximate likelihood of example에 집중)와 GAN(objective function의 정의가 더 유연하지만 delicate and unstable)이 예시

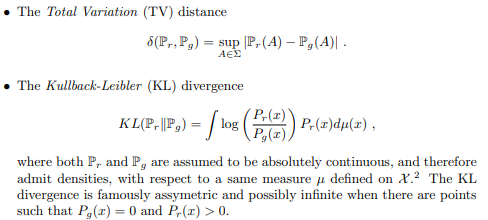

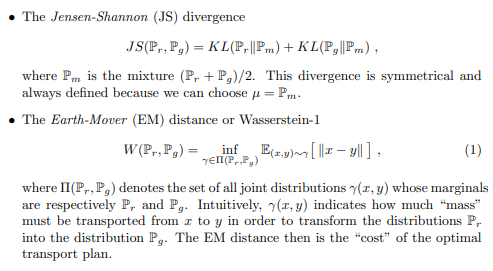

- measure how close the model distribution and the real distribution are(on the various ways to define a distance or divergence)

- continuity = sequence of parameters θt가 θ로 수렴

- θ → Pθ mapping이 continuous인 것은 연속적인 θ → ρ(Pθ, Pr) (=distance) 를 loss function으로 갖고자 하려는데 이와 동일.

- contribution

- (Sec2)theoretical analysis of how Earth Mover(EM) distance 가 popular probability distances and divergences 와 비교해서 어떻게 행동하는지.

- (Sec3)WGAN을 정의하여 합리적이고 효율적인 EM distance의 approximation을 minimize

- (Sec4)WGAN이 GAN의 main training problem 해결, discriminator와 generator의 careful balance 유지가 필요하지 않고, network architecture도 not careful.

2. Different Distances

image space가 [0,1]^d일 때

??어렵다 강의 듣고 다시 정리